先日弊社の代表とデータサイエンティストが

同志社大学理工学部にお邪魔して講義をさせていただきました!

『AI活用における企業リスク』というテーマで、

STAR AIが様々な規模・業種のクライアントに価値提供する中で感じる課題感について

スライド資料を交えながら学生さんたちにお話させていただきました。

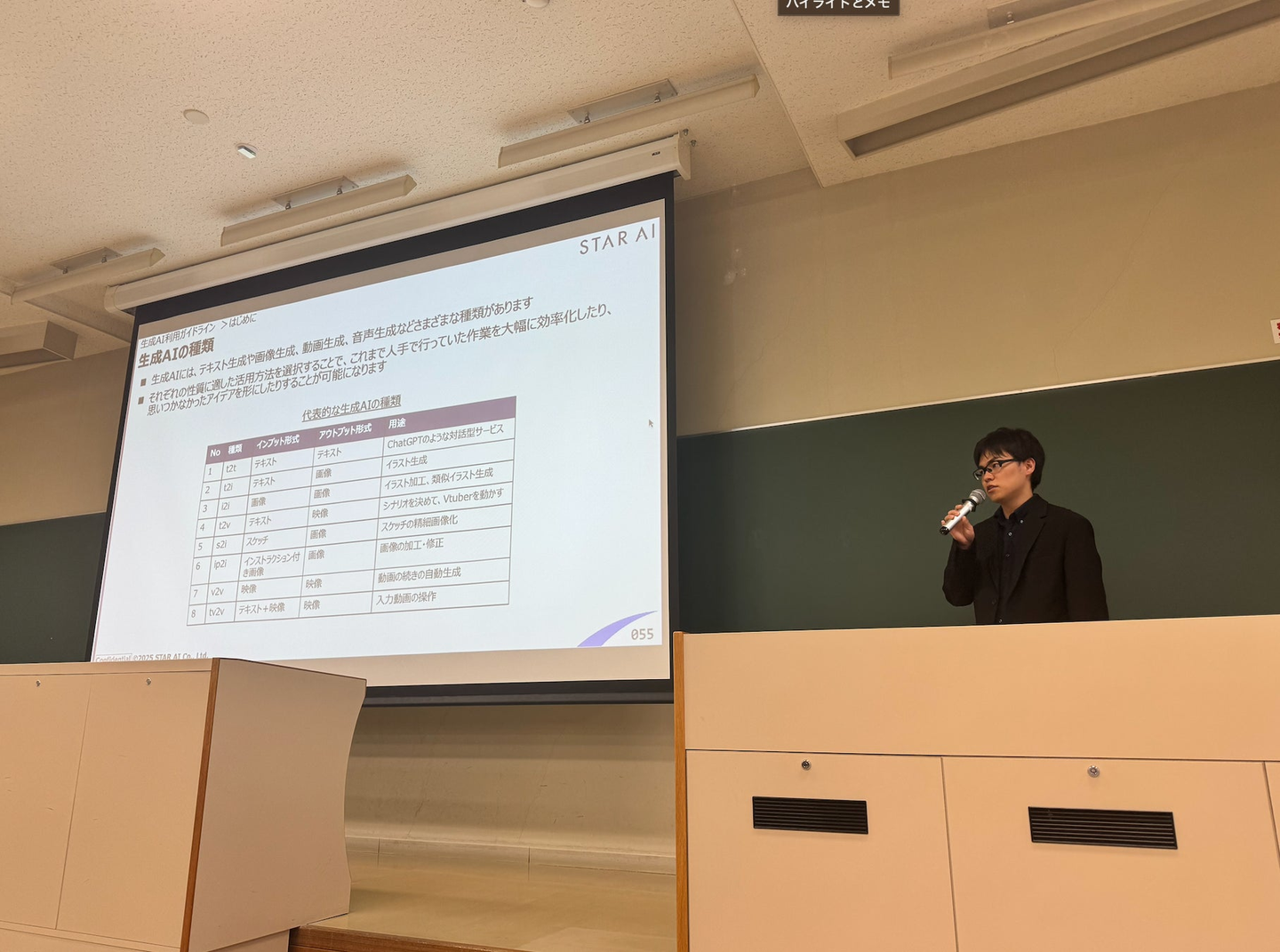

=講義内容=

AIガバナンスポリシー

近年、生成AIは急速に社会に普及してきている一方、

生成AIによる誤った出力や、フェイクニュースの生成といった悪用、著作権の侵害、データ偏りによる誤動作等が社会問題となっています。

このような背景から、AI活用においては技術的な側面だけでなく、公平性といった社会的な視点や倫理的な視点をもつことが求められてきており、AIガバナンスの強化が非常に重要になっています。

本講義では以下の観点を取り上げました。

・倫理・社会受容性の観点

・リスクベースアプローチへの対応

・アジャイル・ガバナンスによる環境変化への対応

・AIマネジメントシステムによるガバナンスの実施

AIリスクと対応ポリシー

AIを含むシステムの設計・開発・導入を行うプロジェクトを実施、またはAIを業務に利用する場合には、AIの利用に伴う法令違反、契約違反、社会的・倫理的批判等に関するリスク(以下 「AIリスク」 )を管理することが重要となります。

本講義では以下の観点でAIリスクと対応ポリシーについても取り上げました。

・技術的リスク:AIの出力の不確実性、内部構造の不透明性に起因するリスク

・社会的リスク:人間の行動や判断、社会に対して影響を及ぼすリスク

そのほか、生成AIを利用するにあたって留意すべきポイントについて、クイズ形式での講義を実施したり、実際に事件となった事例などもお伝えしたりしました。

多数の学生さんから質問をいただけ、時間が足りないくらい盛り上がりました🎉

登壇した、データサイエンティストの大倉さんに、

今回の講義で一番伝えたかったことやAI業界を目指す方へのメッセージを聞いてきました!

■ 講義を通して学生さんに一番伝えたかったことはなんですか?

大倉さん:

AIは人間のように自然な対話や判断を行う一方で、その仕組みや限界を理解せずに使うと、誤情報の拡散、プライバシー侵害、著作権侵害など多くのリスクを引き起こす可能性があります。

便利さの裏には常にリスクが存在し、「どう使うか」こそが最も重要なポイントです。

これからの時代を生きる私たちはAIを正しく理解し、倫理的かつ責任ある使い方を理解することが重要だと伝えました!

思いが学生さんたちにしっかり伝わっていると嬉しいです。

■ 学生さんやこれからAI業界を目指す人へのメッセージをください!

大倉さん:

AIは“人のように考える技術”ですが、AIはツールの1つであり、責任を取るのは常に人間です。

だからこそ、利用者だけでなく、開発者や提供者にも法令遵守・倫理的配慮・社会への影響の理解が欠かせません。

AIの力をどう生かすか、逆に社会に不利益をもたらすかは、扱う人次第です。

リスクを正しく理解し、「安心してAIを使える社会をつくる側」になる意識を持ってほしいと思います!

大倉さん、ありがとうございました!

今後も、STAR AIは教育の場を通じてスタートアップの魅力を発信し、学生のキャリア選択の一助となるとともに日本の活力発展に貢献できるよう活動してまいります!