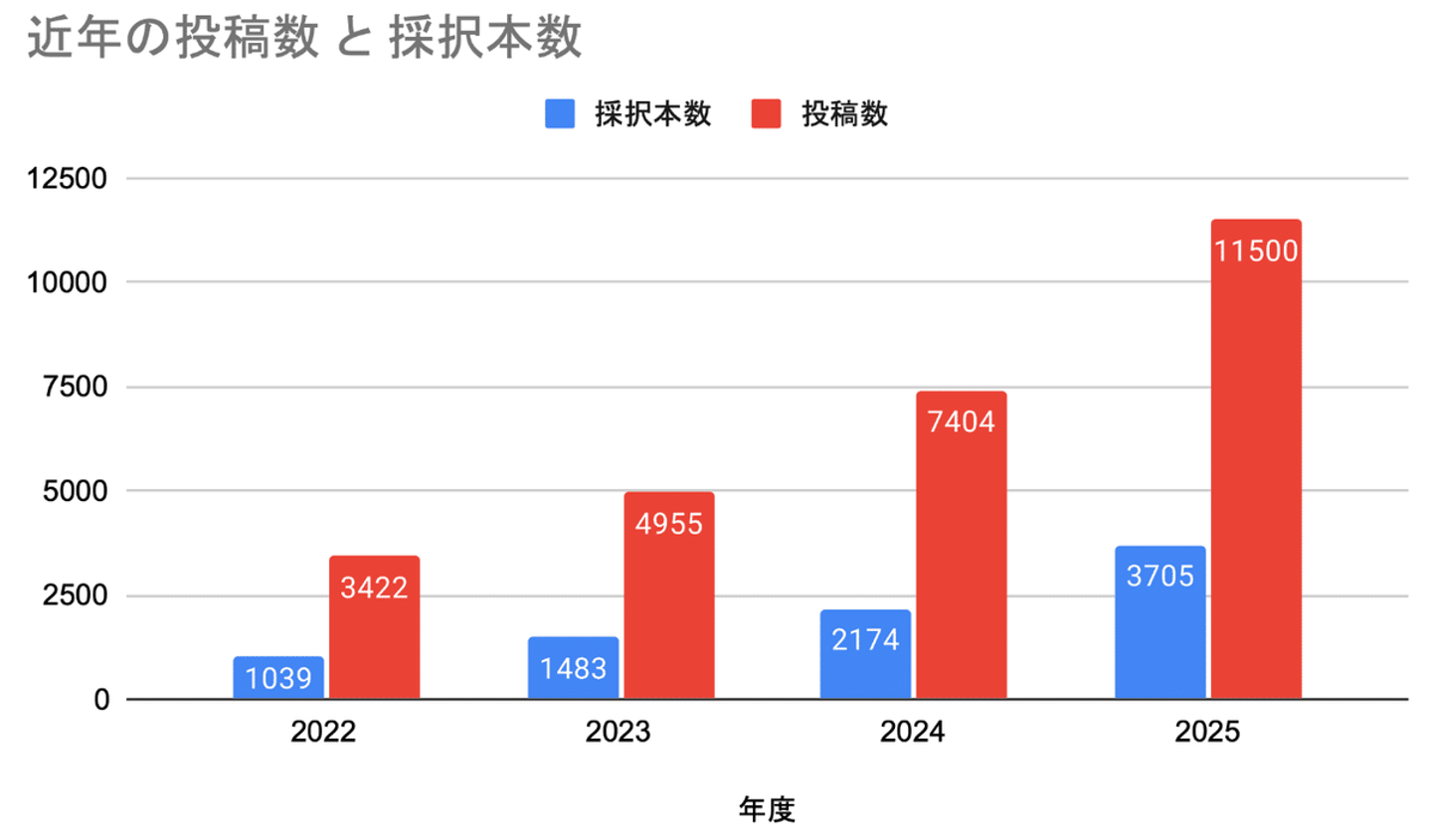

初めまして株式会社 Elith で Computer Vision Reseacher をしている下村です。 4月24日から4月28日にシンガポールで開催された機械学習、深層学習、表現学習のトップカンファレンスであるICLR(International Conference on Learning Representations)2025に参加しました。今年は、シンガポールのExpoで開催されました。投稿数は過去最大級の11,500本にのぼり、その中から3,705本が採択されました。採択率は約32%であり、採択論文の中では、213本が口頭発表として、また380本がスポットライト発表として選ばれ、全体的な注目度の高い研究が数多く紹介されました。

投稿数と採択本数の関係

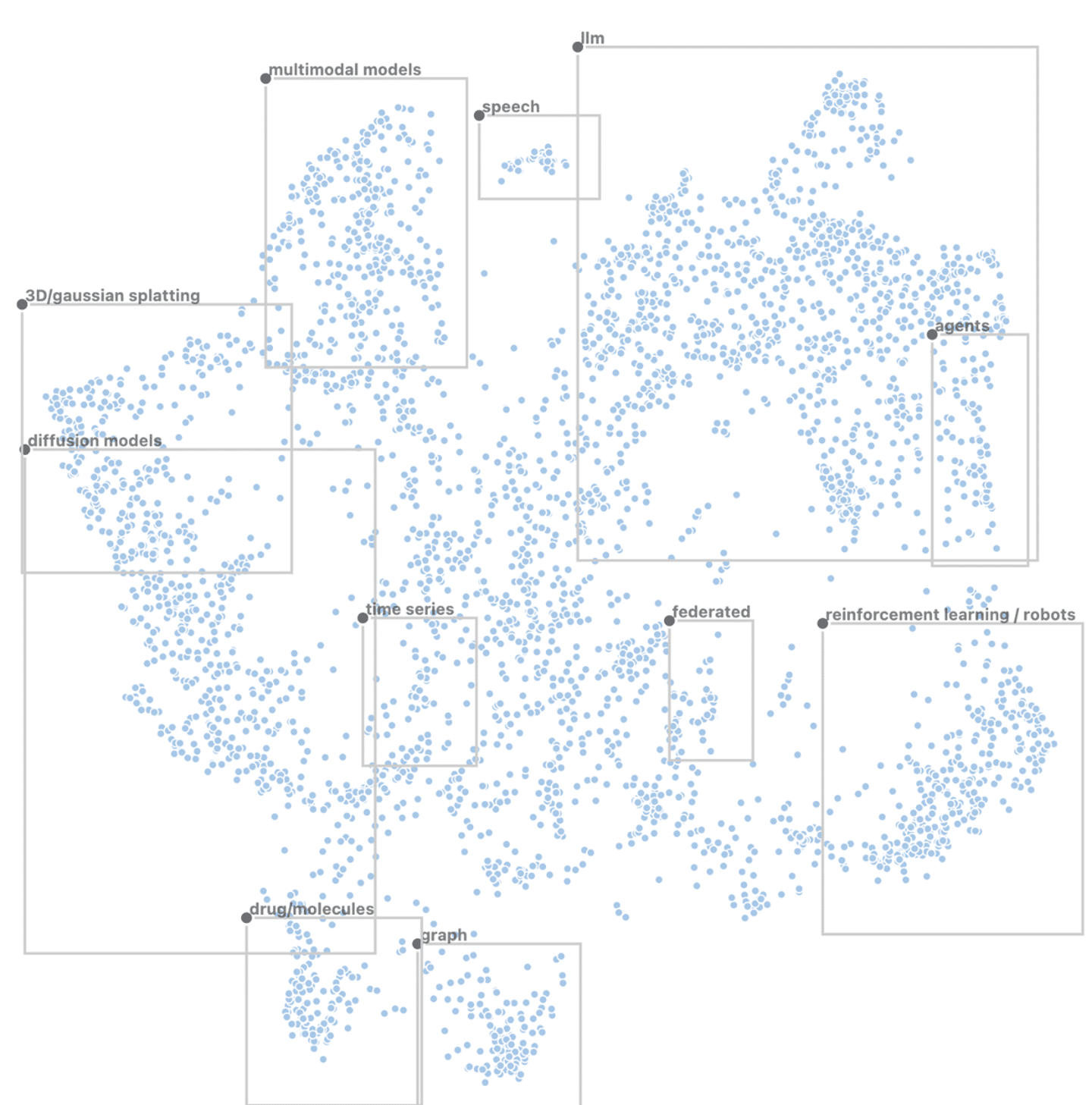

研究トレンド

論文のトレンドについても見ていきます。以下の図から分かる通り、LLMやDiffusion Modelに関する研究が最も多く、それに続いて3D・Gaussian Splatting、強化学習・ロボティクスに関する研究が多く発表されています。そのほかにも、マルチモーダル、グラフニューラルネットワーク、エージェントといった分野の研究も数多く見受けられます。LLMやDiffusion Modelは、一般的に学習コストが高く、取り組むハードルが高いと感じられがちですが、今回はPost-TrainingやTest-Time Adaptationなど、すでに学習済みのモデルを低コストで賢く活用する研究が多く見られました。このような動向はICLR2025に限らず、CVPRなど他のトップカンファレンスでも共通しており、今後ますます求められる技術であると感じました。

研究トレンドグラフ

論文一言まとめ

本稿では、ICLR 2025のポスターセッションで個人的に興味深いと感じた論文を、簡単に紹介していきます。国際会議におけるポスターセッションの回り方には人それぞれのスタイルがあると思います。事前に気になる論文をチェックしてからポスターを見に行く方も多いと思いますが、私の場合は、事前にある程度リサーチしたうえで、体力の続く限りすべてのポスターを一通り見て回ることを心がけています。手法の内容はもちろんですが、トップカンファレンスのポスターはデザインや構成も非常に洗練されており、見ているだけでも多くの学びがあります。カッコよく、分かりやすく、引き込まれるようなポスターは、まさに全研究者の憧れです。前置きが長くなりましたが、ここからは各論文の一言まとめを掲載していきます。ポスター画像は、ICLR 2025の公式サイトから引用しています。

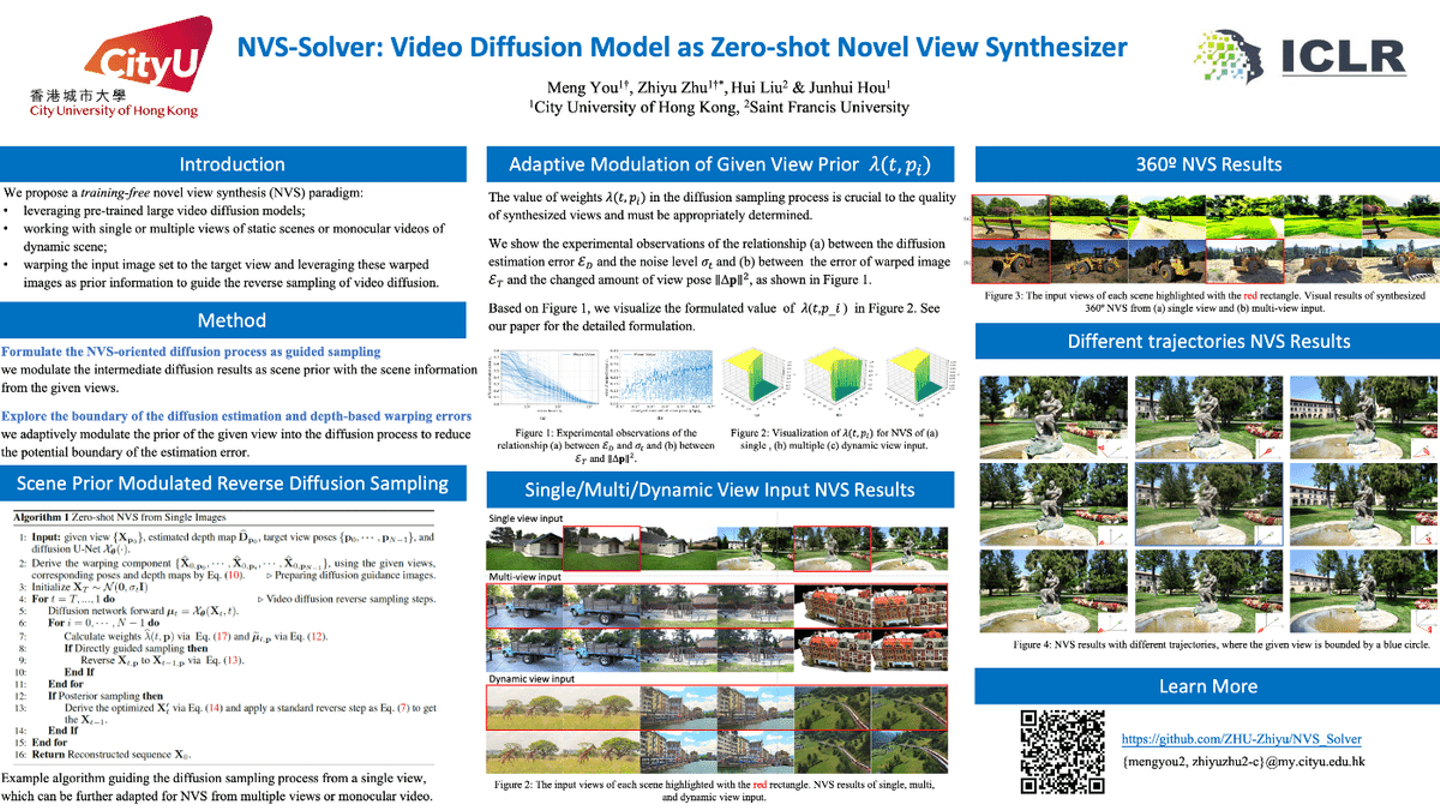

NVS-Solver: Video Diffusion Model as Zero-Shot Novel View Synthesizer[M.You+, ICLR2025]

本手法は、Video Diffusion Modelを用いたZero-shotのNovel View Synthesize(NVS)手法です。生成の際、任意のポーズのwarp画像で条件付けすることが重要と述べています。warp誤差を小さくすることで拡散誤差も小さくなることを指摘しそれを解決しています。

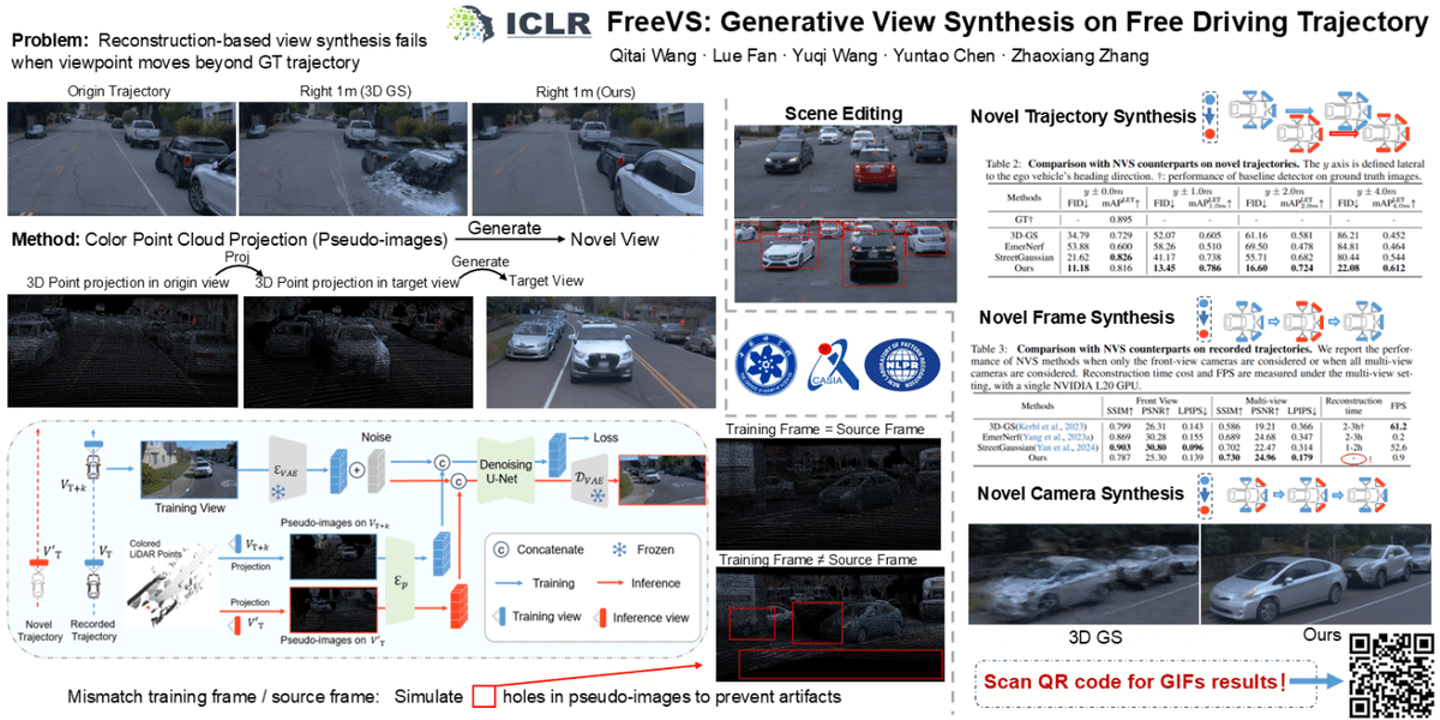

FreeVS: Generative View Synthesis on Free Driving Trajectory[Q.Wang+, ICLR2025]

本手法は、NVS時のアーティファクトを改善するために提案されました。通常のGaussian Splatting(GS)は、データに含まれないカメラ方向の再構成が機能しません。そこで、点群に色情報を付与し新規ポーズの擬似画像を作成し、Diffusion Modelの条件付けに使用することで高精度なNVSを実現しています。一般的なGSでは、Gaussianの初期化に点群を使うことが多いですが、新規視点生成の条件付けに点群を活用した個人的に好きな手法です。

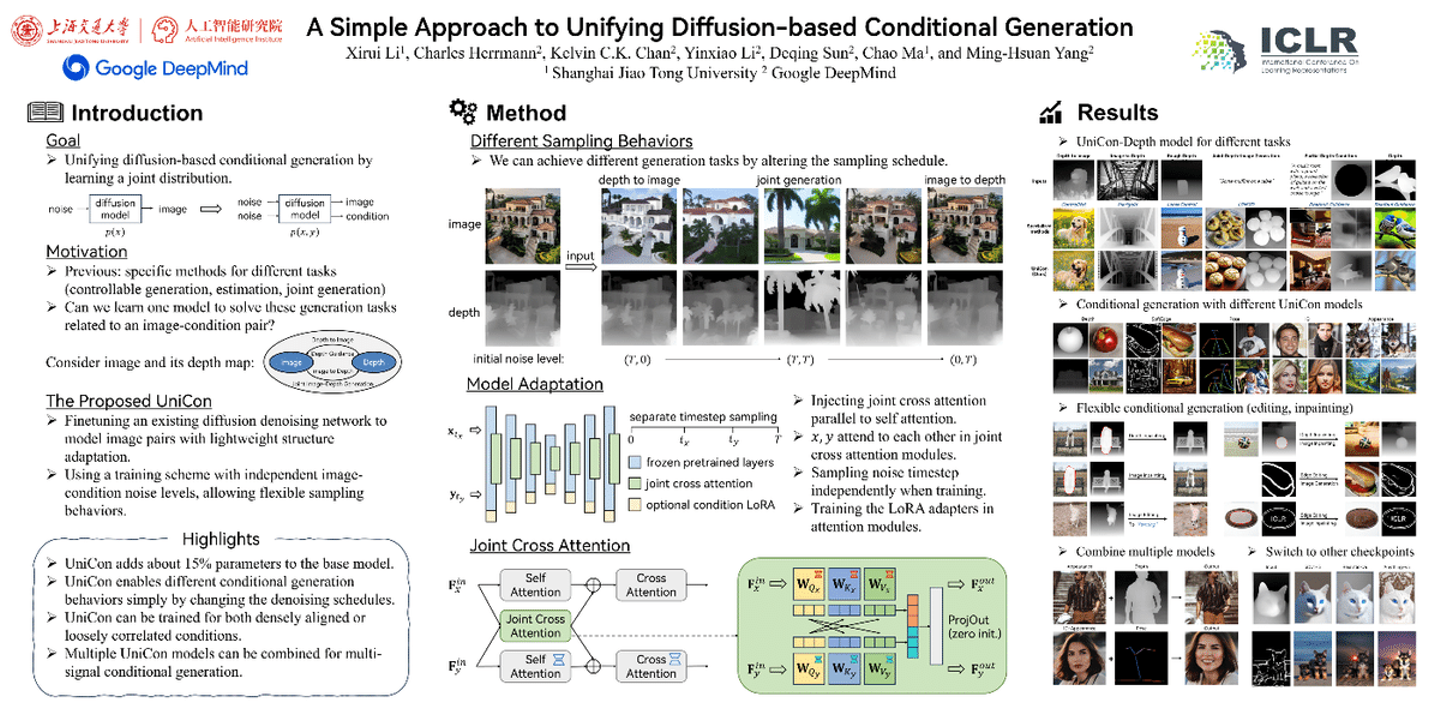

A Simple Approach to Unifying Diffusion-based Conditional Generation[X.Li+, ICLR2025]

本手法は、様々な条件付き生成(depth-to-image, edge-to-image, pose-guided generation など)タスクのモデルに共通する構造を生かし、単一の統一的なフレームワークを提案しています。ベースモデルにわずか15%のパラメータを追加するだけで実現可能です。条件付け生成の能力を獲得するためにLoRAを活用しているところが面白いです。

TULIP: Token-length Upgraded CLIP[I.Najdenkoska+, ICLR2025]

本手法は、絶対位置エンコーディングに基づき設計されたCLIPの問題点である最大77トークンまでした入力情報を処理できない制約を改善するために提案されました。TULIPは、従来と異なり相対位置エンコーディングを導入しつつ、元のCLIPの能力を保ったまま拡張可能な設計を実現しています。

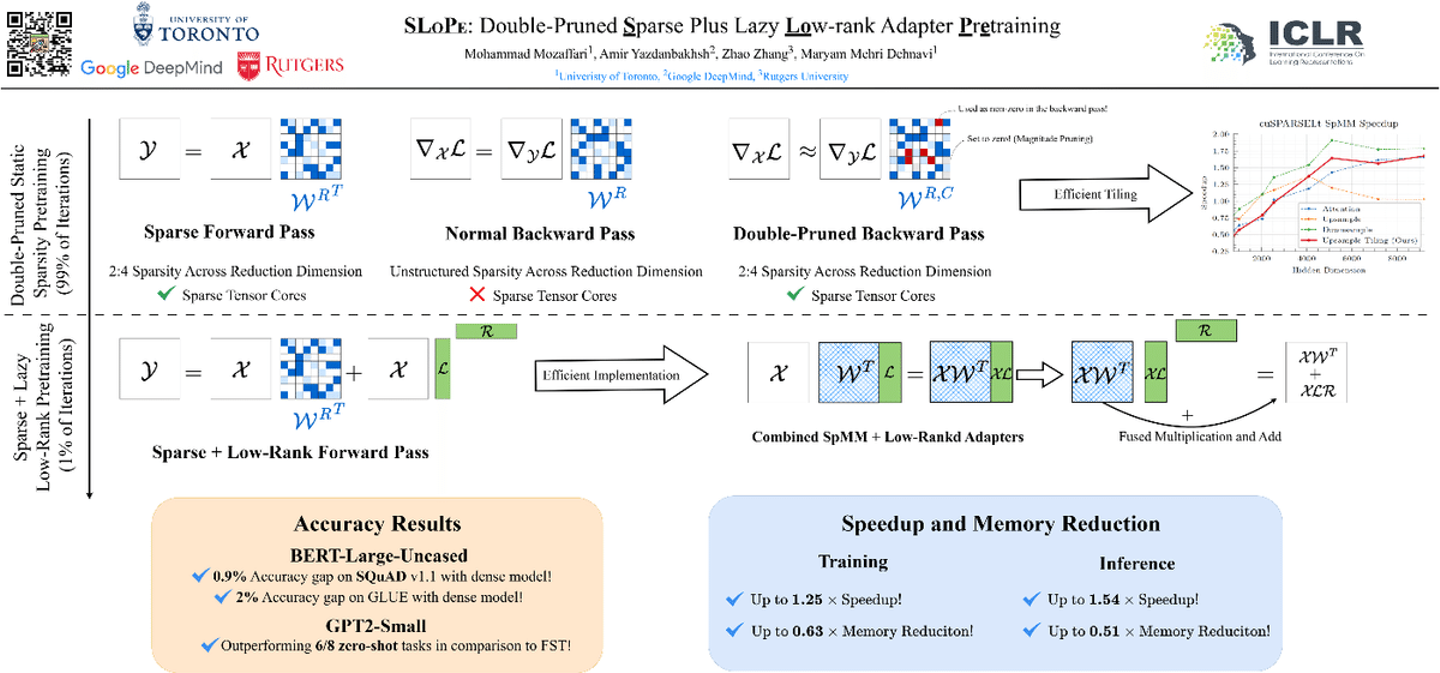

SLoPe: Double-Pruned Sparse Plus Lazy Low-Rank Adapter Pretraining of LLMs[M.Mozaffari+, ICLR2025]

近年、LLMのスパース化によって計算効率とメモリ使用量を削減する試みが進んでいます。しかし、スパースモデルは一般に精度が低下するという課題があります。そのため、従来はスパースで事前学習 → デンスでファインチューニングという手法が用いられていました。本研究では、この課題に対し、Low-Rank Adapterをスパース事前学習の最後の1%だけ導入し、精度と効率の両立を実現する新しい手法を提案しています。

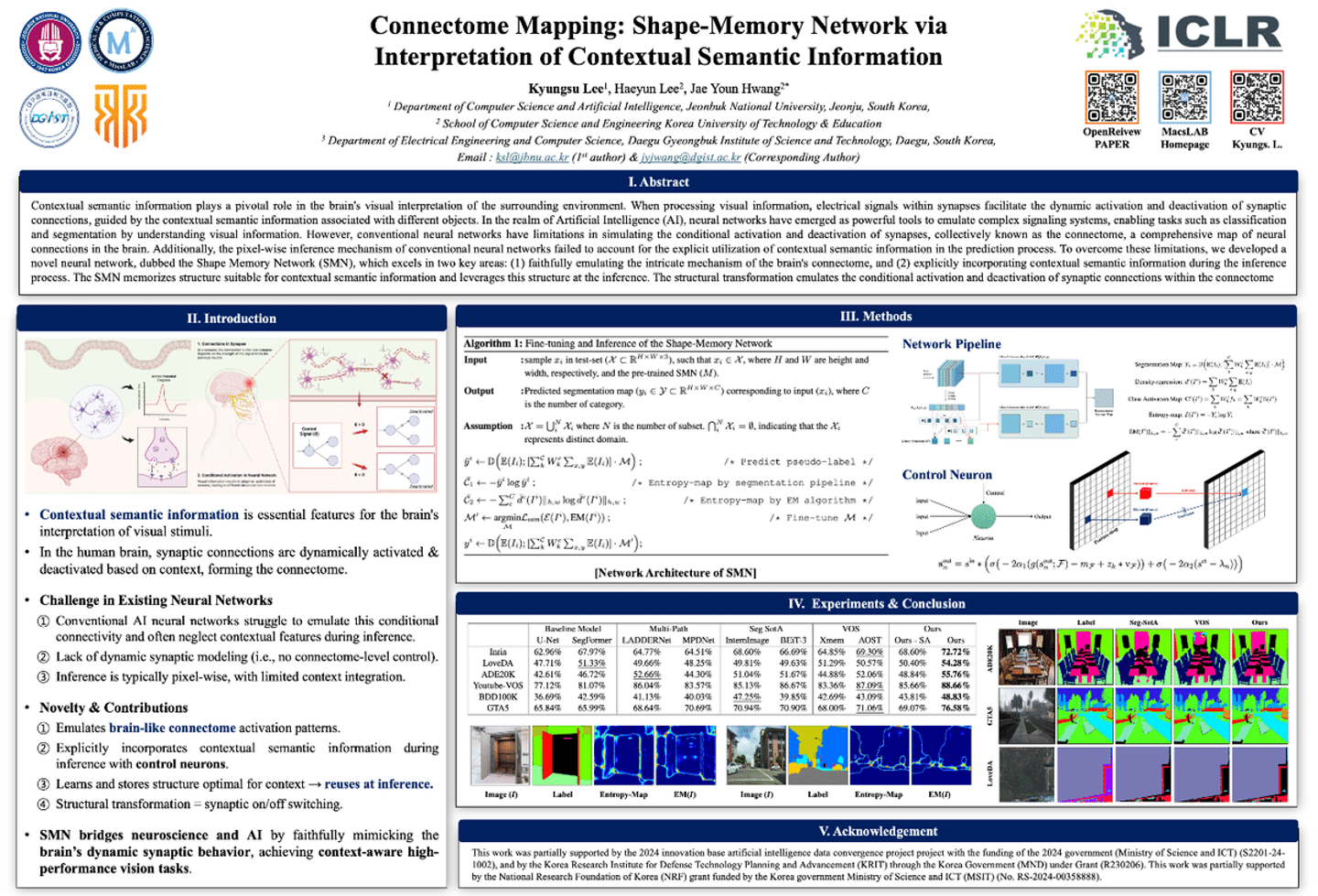

Connectome Mapping: Shape-Memory Network via Interpretation of Contextual Semantic Information[K.Lee+, ICLR2025]

本手法は、脳の神経接続コネクトームを模倣し、文脈的意味情報を記憶し推論時に接続構造を動的に切り替えるセグメンテーション手法です。Control Neuronが文脈に応じた構造を選択し、アクティベーションマップからEntropy mapを作成しています。記憶された構造を再利用することで、推論時に動的にニューロンのアクティベートを判断することで高精度かつ柔軟な推論を実現しています。セグメンテーションだけでなく、物体検出や物体認識でも機能します。

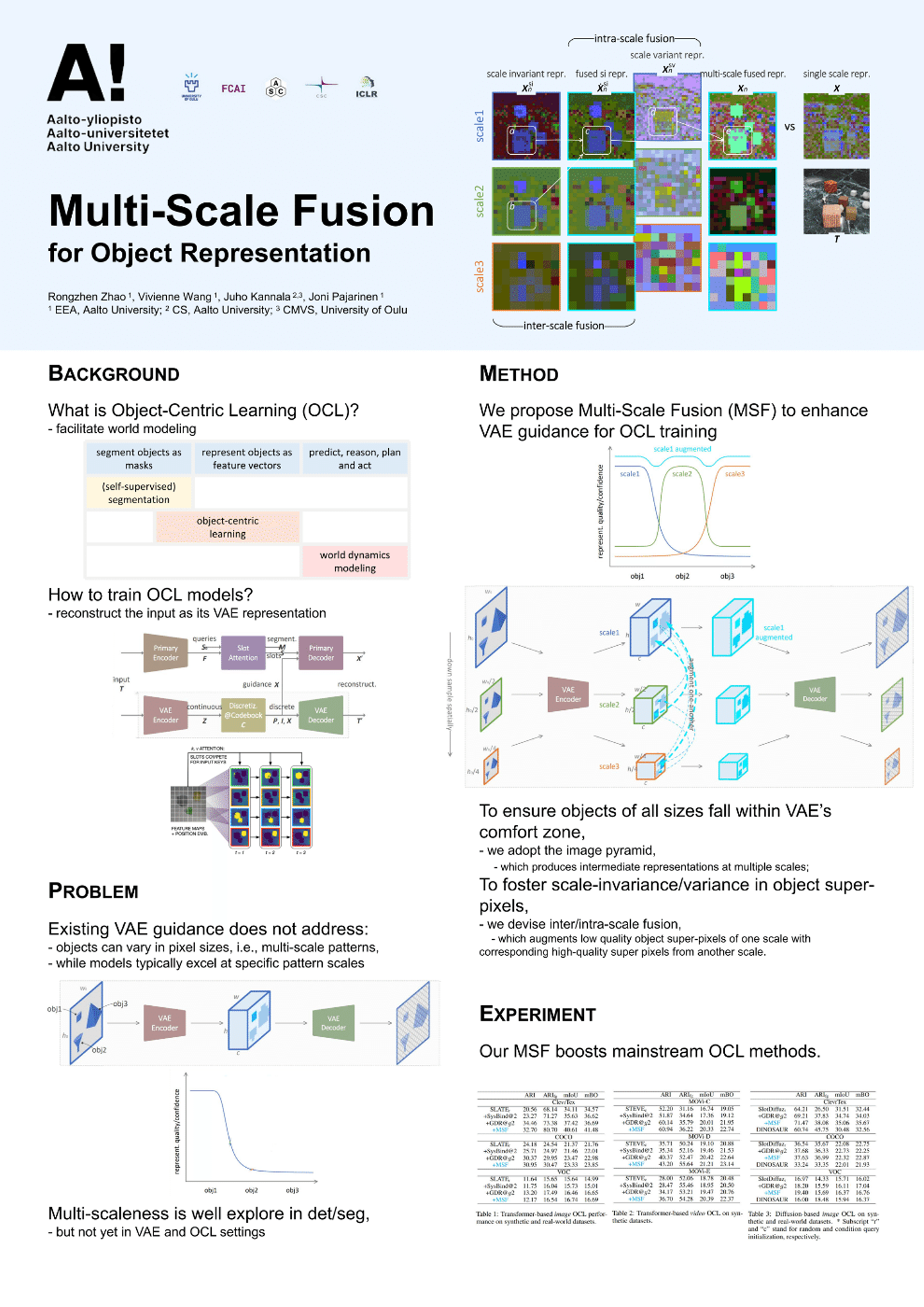

Multi-Scale Fusion for Object Representation[R.Zhao+, ICLR2025]

Object Centric Learning(OCL)のタスクにおいてVAEは得意不得意のスケールがあります。そのため、VAEのコンフォートゾーンにリスケールし、その後マルチスケール特徴とFusionする手法を提案しています。これによりスケール不変な物体表現を獲得しています。

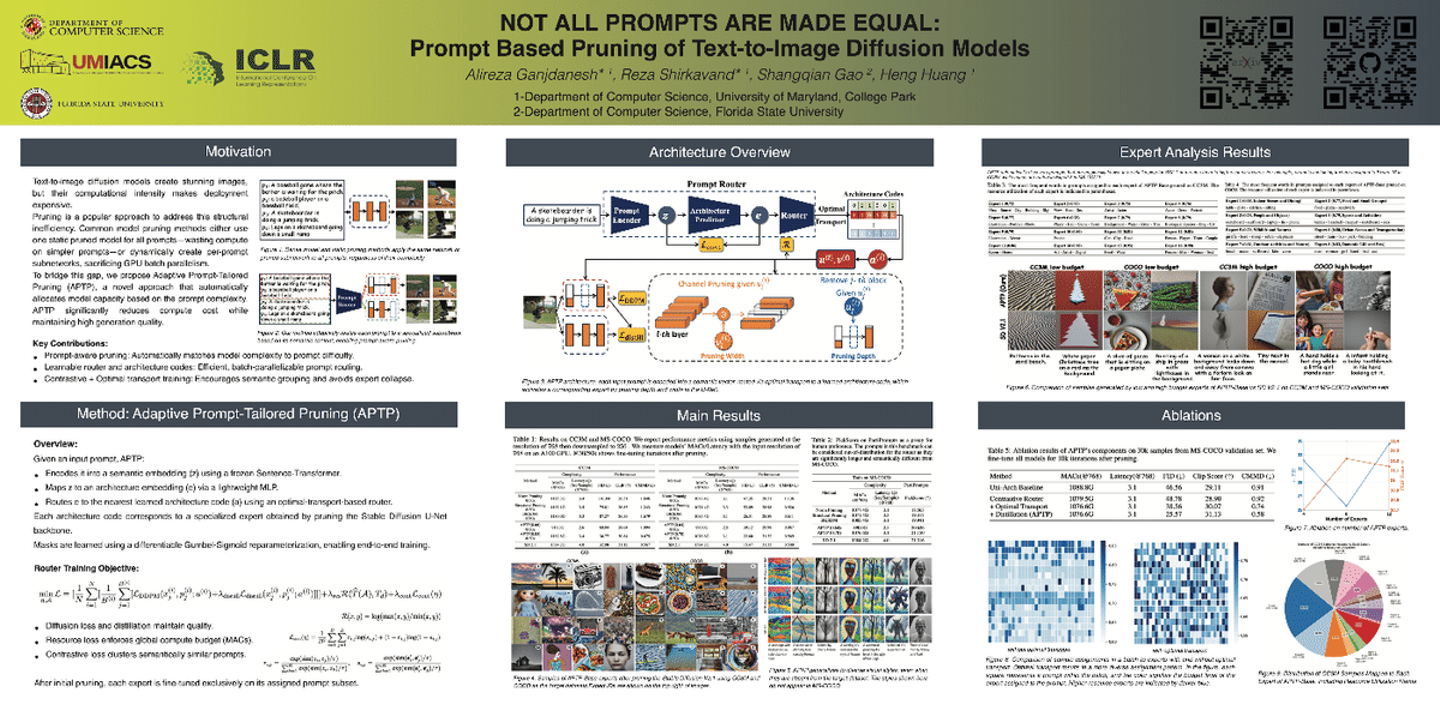

Not All Prompts Are Made Equal: Prompt-based Pruning of Text-to-Image Diffusion Models[A.Ganjdanesh+, ICLR2025]

本手法は、Text-to-Image Diffusion Modelsにおいて、プロンプトごとに適応的にパラメータを削除する手法です。従来手法は、従来は全プロンプトに同じ圧縮モデルを適用する静的手法や、動的刈り込みは、プロンプトごとに個別のサブネットワークを利用することでこの問題に対処するが、GPU上でのバッチ並列性が困難な課題がありました。本手法では、プロンプトを意味ベクトルに変換し、最適なアーキテクチャコードにマッピング。それぞれに適したモデルを割り当てることで、高精度を維持しながら計算コストとメモリ使用量を大幅に削減しています。

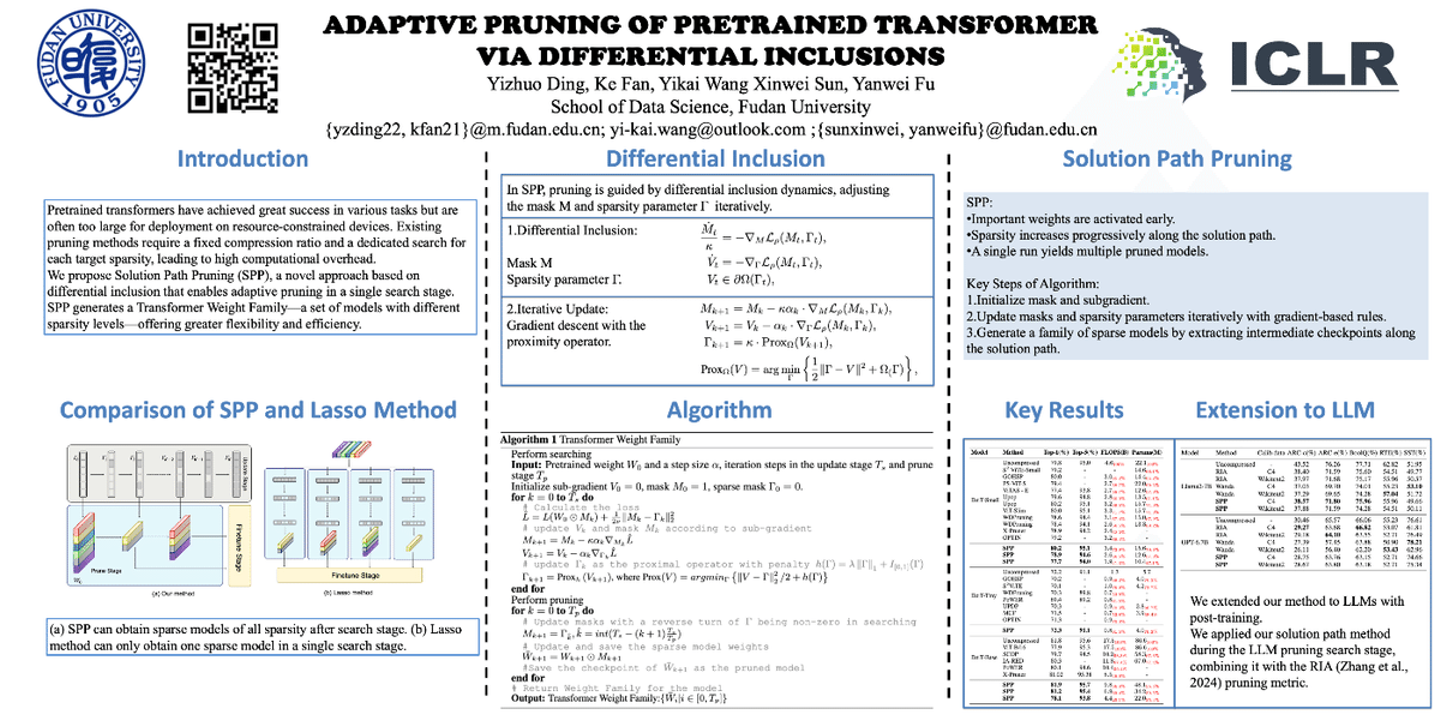

Adaptive Pruning of Pretrained Transformer via Differential Inclusions[Y.Ding+, ICLR2025]

本手法は、大規模Transformerモデルを1回の処理で複数の比率で枝刈り可能な手法です。一般的な枝刈り手法は、任意の比率ごとにモデルを何度も作り直す必要がありますが、本手法は1回の処理で複数の比率で枝刈り可能です。微分包含力学に基づいてマスクパラメータを更新しながら疎性構造を連続的に変化させることで、異なる比率のモデル群を一括生成します。クエリ・キーや線形層のペアごとに低ランク圧縮を施す設計により、内部構造を保ったまま柔軟に枝刈りが可能です。既存のLasso法と異なり、SPPは1回の探索であらゆる比率のモデルを得られるため、計算コストを大幅に削減しつつ、様々なタスクや制約条件に合わせたモデル選択を実現しています。

終わりに

ICLRへの現地参加は非常に有意義なものでした。どの研究も、リサーチクエスチョンから問題解決までの研究の流れが美しく勉強になりました。精度の上下に一喜一憂するのではなく、その手法が抱える根源的な課題に目を向けることが重要だと改めて感じました。また、会議を通してGaussian SplattingやDiffusion Modelの論文も数多く見られました。今回のICLRでは、高精度なニューラルシミュレータを構築するために重要となる研究が多く今後の進展が非常に楽しみです。 本記事では、簡単な論文紹介になってしまいましたが、機会があれば別の記事で詳しくお話しできればと考えています。興味を持たれた方はぜひフォローいただき、続編の記事もチェックしてみてください。それでは、またどこかの国際会議でお会いしましょう!

参考文献

- NVS-Solver: Video Diffusion Model as Zero-Shot Novel View Synthesizer[M.You+, ICLR2025]

- FreeVS: Generative View Synthesis on Free Driving Trajectory[Q.Wang+, ICLR2025]

- A Simple Approach to Unifying Diffusion-based Conditional Generation[X.Li+, ICLR2025]

- TULIP: Token-length Upgraded CLIP[I.Najdenkoska+, ICLR2025]

- NVS-Solver: Video Diffusion Model as Zero-Shot Novel View Synthesizer[M.You+, ICLR2025]

- SLoPe: Double-Pruned Sparse Plus Lazy Low-Rank Adapter Pretraining of LLMs[M.Mozaffari+, ICLR2025]

- Connectome Mapping: Shape-Memory Network via Interpretation of Contextual Semantic Information[K.Lee+, ICLR2025]

- Multi-Scale Fusion for Object Representation[R.Zhao+, ICLR2025]

- Not All Prompts Are Made Equal: Prompt-based Pruning of Text-to-Image Diffusion Models[A.Ganjdanesh+, ICLR2025]

※こちらの記事の情報は2025/05/08時点での情報となります。

/assets/images/21474457/original/ef5ea249-1b5a-48e2-aa4d-7359fa469ce6?1751329230)

/assets/images/21474457/original/ef5ea249-1b5a-48e2-aa4d-7359fa469ce6?1751329230)